Digital Objekte in einer echten Szene zu platzieren, das ist mittlerweile vielen als Augmented Reality geläufig. Weniger bekannt ist deren Gegenstück, Diminished Reality (DR). Sie macht es möglich, Objekte aus einer Szene zu entfernen und die dadurch entstehende Leere plausibel zu füllen. Um dies in einem dreidimensionalen Raum zu bewerkstelligen, benötigten bisherige Verfahren einiges an Rechenpower und konnten die adaptierte Szene nur mit Zeitverzögerung und teilweise fehlerhaften Darstellungen erzeugen. Einem Team um Dieter Schmalstieg, Shohei Mori und Denis Kalkofen vom Institute of Visual Computing der TU Graz ist es nun gemeinsam mit Hideo Saitos Team an der Keio University in Japan mittels der Verknüpfung verschiedener Technologien gelungen, dreidimensionale Objekte durch Diminished Reality in Echtzeit verschwinden zu lassen. Dadurch lässt sich ein Raum durch eine Kamera live in seiner veränderten Form betrachten.

Photoshop für bewegte 3D-Bilder

„Vereinfacht gesagt, kann man sich Diminished Reality wie eine Art Photoshop für 3D-Szenen vorstellen“, sagt Shohei Mori. „Manche denken vielleicht als Erstes daran, wie sie damit unliebsame Dinge aus Urlaubsvideos entfernen können. Das ist eine Herausforderung, wäre aber durchaus möglich. Es gibt allerdings einige andere Bereiche, wo DR-Anwendungen äußerst nützlich sind.“ So eröffnen sich in der Industrie neue Perspektiven für die Simulation von Fehlfunktionen in Trainingsdatensätzen für autonome Fahrzeuge oder für die effiziente Vorvisualisierung (PreVis) von Filmszenen an realen Drehorten, die beim Location Scouting noch völlig anders aussehen als gewünscht. Auch im medizinischen Bereich könnte DR einen Beitrag leisten, indem etwa bei chirurgischen Eingriffen störende Elemente aus dem Blickfeld der Aufnahmekameras verschwinden, um störungsfreies Lernmaterial für Studierende zu erhalten.

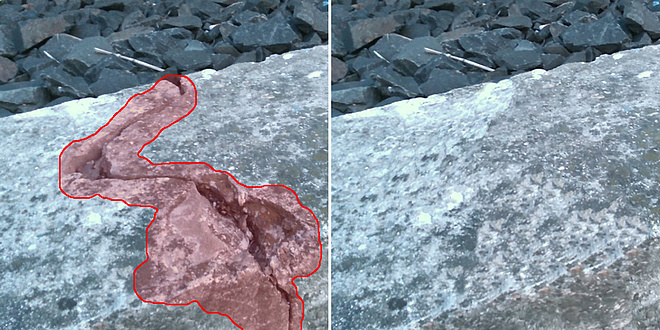

Die neue Technologie mit dem Namen InpaintFusion nutzt als Basis das sogenannte 2D Inpainting und entfernt letztendlich Objekte aus einer 3D-Szene. Dabei werden Benutzereingaben auf einem 2D-Bildschirm auf eine 3D-Szene projiziert, um die zu entfernenden Bereiche festzulegen. Ein Schlüsselbild (Keyframe) dient als Ausgangspunkt, und durch das Sammeln und Zusammenführen von passenden Pixeln aus der Umgebung des zu entfernenden Objekts wird ein plausibler Hintergrund erzeugt. Um dies in 3D zu realisieren, werden Farbinformationen und Tiefendaten der gescannten Szene gleichzeitig optimiert, sodass das Ergebnis auch bei veränderter Kameraperspektive überzeugend aussieht. Dem Forschungsteam ist es gelungen, das 3D Inpainting auf volumetrische 3D-Bilddaten (Multi-Layer Images) anzuwenden, was zu einer höheren Qualität bei der Wahrnehmung der Objektentfernung führt.

Toolkits für breiteres Publikum

Die größte Herausforderung war, die Verarbeitungsschritte in Echtzeit möglich zu machen. Hierbei setzten die Forschenden auf zwei unterschiedliche Technologien: Fast Patch Matching und Multithreading. Beim Patch Matching werden für das Sammeln und Zusammenführen der passenden Pixel randomisiert die optisch naheliegendsten Umgebungspixel für den zu füllenden Bereich gesucht. Das müssen nicht immer die besten sein, aber in Summe liefern sie glaubhaftes Füllmaterial, ohne Millionen von Pixeln durchrechnen zu müssen. Das Multithreading nutzt die Möglichkeit von Computerprozessoren, auf jedem Prozessorkern parallel mehrere Prozesse gleichzeitig auszuführen. Bei der Diminished-Reality-Lösung des Forschungsteams läuft die rechenintensive 3D-Inpainting-Berechnung im Hintergrund, während der Haupt-Thread die visuelle Darstellung steuert. Dadurch bekommen die Nutzer*innen das Endergebnis ohne Verzögerung angezeigt und können sich durch den Raum bewegen, ohne dass das entfernte Objekt wieder im Bild erscheint.

„Die Echtzeit-Darstellung von Diminished Reality ist ein wichtiger Schritt für diese Technologie“, sagt Shohei Mori. „Nun gilt es, die passenden Toolkits zu entwickeln, damit diese Möglichkeiten einem breiteren Publikum zugänglich gemacht werden können. Ein weiteres Ziel ist die schnelle und effiziente Erzeugung von 3D-Modellen aus wenigen Einzelbildern. Das würde Diminished Reality noch eine zusätzliche Dimension verleihen.“

Sie möchten die aktuellen Stories, News, Forschungsgeschichten, Interviews oder Blogbeiträge der TU Graz direkt auf Ihr Smartphone oder in Ihren E-Mail-Eingang erhalten? Abonnieren Sie kostenfrei den TU Graz-Telegram-Newsletter.